扫描分享

本文共字,预计阅读时间。

随着人工智能技术的迅猛发展,尤其是大型语言模型的广泛应用,AI是否具备类似人类认知的“涌现”能力,成为当前最热议的话题之一。所谓涌现现象,指的是简单组件相互作用,产生出远超预期的新能力,这一现象引发了科技界对AI未来潜力的激烈讨论。然而,涌现现象在AI领域中的存在与重要性仍存争议,科技界的领袖们对此持有不同看法。他们的观点既反映了对AI潜力的乐观期望,也揭示了对其局限性的谨慎态度。

OpenAI首席执行官Sam Altman认为,大型语言模型展现了许多出乎意料的能力,可被视为“涌现”现象。随着模型规模和复杂性的提升,AI系统可能会表现出越来越多难以预测的行为。比如,GPT-3和GPT-4展示了高质量文本生成能力,不仅超越了简单的词汇预测,还展现了对语境和语义的深刻理解,甚至能够进行创意写作和编程。

深度学习领域的先驱Geoffrey Hinton持相似观点,认为随着模型规模的扩大,AI中的涌现现象愈加明显。这些模型在训练过程中获得的知识和能力,源于庞大数据的复杂模式,而非程序员的直接设计。他指出,大模型在没有明确编程的情况下学会了自然语言的识别和生成,这是一种新兴的机器学习现象。

DeepMind联合创始人Demis Hassabis也强调,涌现是理解智能的关键方式。他认为,AI在复杂任务中展示出的能力往往超出研究人员的最初设想,这表明涌现现象在智能系统中发挥了重要作用。AlphaGo通过深度学习和强化学习掌握了超越人类水平的围棋技能,就是这种现象的典型案例。

然而,并非所有人都认同AI的“涌现”现象。认知科学家Gary Marcus对此持怀疑态度,认为这些能力常常被夸大。Marcus指出,这些模型依赖数据驱动的统计学习,而非真正的理解或智能,它们在现实世界中的常识推理任务上表现不佳,未能展现出超越其数据训练范围的能力。

Meta首席AI科学家Yann LeCun也对涌现现象的重要性持保留态度。他承认大模型展示了一些惊人的能力,但并不认为这证明了它们具备人类智能的涌现现象。LeCun认为,当前的AI模型依然受限于数据和算法,在没有大量数据支持的情况下,难以应对新的任务或环境。

在这场关于AI涌现现象的辩论中,科技界展现了复杂的态度:一方面,对其潜力充满期待,另一方面,又对其局限性深感忧虑。本文将从“什么是涌现”、功能涌现与意识涌现的区别入手,深入探讨AI涌现现象的内在逻辑及其面临的挑战。

什么是涌现?

“涌现”(Emergence)最早起源于哲学领域。19世纪,英国哲学家乔治·亨利·刘易斯(George Henry Lewes)首次用这个词来描述那些无法通过组成部分的性质解释的整体特性,即“整体大于部分之和”的现象,也就是所谓的“1+1>2”。虽然“涌现”作为哲学概念被讨论了很长时间,并经常出现在科技前沿的形而上学分析中,但本文将避免使用这些形而上学的概念,而是从复杂系统科学和计算机科学的角度来解读“涌现”。

系统科学家穆雷·盖尔曼(Murray Gell-Mann)和斯图尔特·考夫曼(Stuart Kauffman)通过对复杂系统中自组织行为的研究,进一步发展了“涌现”的概念。他们认为,“涌现”指的是在复杂系统内,简单组件通过相互作用自然产生的某些特性或现象。这意味着,整体所展现的特征或行为不能简单地从其组成部分的性质中推导出来,而是在这些部分的相互作用中自发产生的。涌现现象侧重于解释复杂系统如何在没有外部指令或中央控制的情况下,通过系统内部的简单规则和相互作用,形成新的有序结构和行为。这表明,复杂性可以自然地产生,而不需要外部干预或预先的详细设计。

涌现的核心特征包括:

自组织性:涌现行为是自发的,不依赖外部的中央控制或指令。系统通过自身的动态过程,自然而然地形成某种有序结构。

简单规则的非线性作用:涌现行为源于系统中组成单元(如个体、细胞、分子等)之间的非线性相互作用。尽管这些相互作用可能看似简单,但它们的组合和交互作用会导致难以预测的整体行为。

多尺度的涌现:涌现现象可以发生在不同层次或尺度上。例如,从原子到分子、从分子到细胞、从细胞到有机体,每个层次都展示出新的行为或特性,形成一个层次化的过程。

有序性边缘性:涌现往往发生在系统介于混乱和有序之间的“临界状态”。在这一状态下,系统的自组织能力最强,涌现行为最为明显,这是复杂系统(如生态系统、经济体、生物系统)自发形成复杂结构和功能的关键条件。

不可预测性和创造性:即使已知所有组成部分的性质和规则,系统的整体行为仍然难以完全预测。这样的创造性是涌现的核心特点,显示出复杂系统具备生成新结构和功能的潜力。

凯文·凯利(Kevin Kelly)在其著作《失控》中深入探讨了复杂系统如何通过简单规则和组件的相互作用,产生出比其单个部分更复杂、更不可预测的行为。他以大量实例说明了“涌现”如何在自然界和技术系统中起作用,例如蚁群行为、市场经济和生态系统等,这些都体现了典型的涌现现象。

规模的力量:AI大模型走向涌现之路

近年来,人工智能研究发现,随着模型规模(如训练计算量或参数数量)的增加,AI系统会表现出“涌现”现象。这种现象意味着,当模型达到某个临界规模后,其能力会突然从接近随机的水平跃升至远高于随机的水平,这种不可预测的能力提升是小规模模型无法预见的。研究表明,这种涌现能力与模型的规模密切相关,并且在处理多样化任务时表现得尤为突出。

正如Bommasani等人(2021)所定义的:“涌现意味着系统的行为是隐式诱导的,而不是显式构建的,这既是科学进步的源泉,也带来了对意外后果的担忧。”在Google的研究《Emergent Abilities of Large Language Models》中,研究者借用Philip Anderson 1972年论文《More Is Different》的定义,解释了大语言模型中的涌现现象:“涌现是指当系统的某些参数或特征(如数量、规模、强度等)发生渐变时,在某个临界点上,这些变化引发系统整体行为的根本性改变。” 换句话说,在大规模语言模型中,随着参数数量、训练数据量、计算资源的增加,模型的能力可能出现质的飞跃,表现出在小规模模型中无法观察到的新能力或行为。

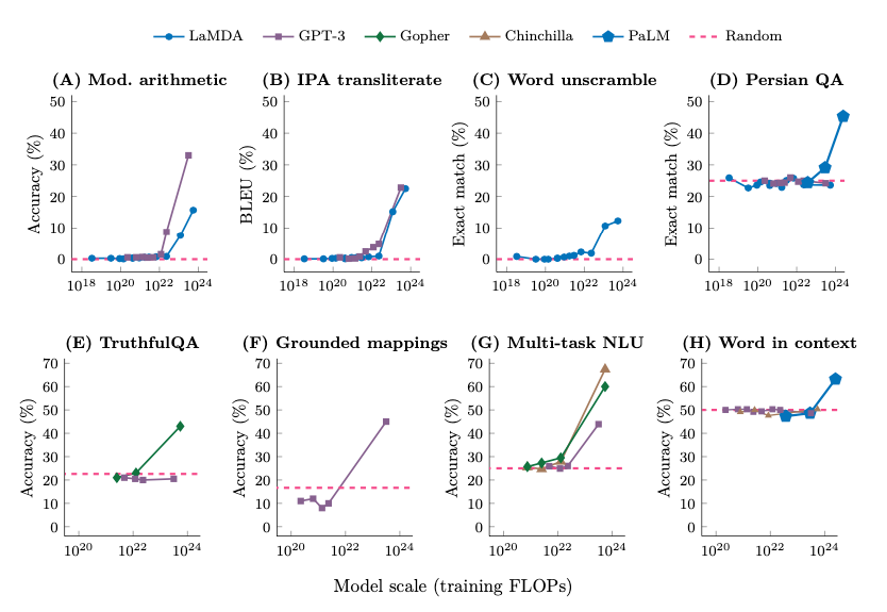

少量样本提示任务中的涌现能力(Few-Shot Prompting Abilities)

大规模模型在少量样本提示任务中的表现远超小规模模型。例如,在算术运算(如三位数加减法和两位数乘法)中,模型的准确性从接近随机水平大幅提升到远超随机水平。同样,在国际音标转录任务中,AI模型的表现从低于随机水平飙升至优于随机水平,展示出强大的语言处理能力。对于单词拼写重组任务(如将打乱的字母重新排列成正确单词),大规模模型显示出更强的语言理解和处理能力。此外,在多语言问答(如波斯语问题回答)和真实性测试(TruthfulQA)中,大规模模型大幅超越小规模模型,展现了更高的知识准确性和推理能力;在多任务语言理解(MMLU)测试中,大模型在多个学科的任务中表现优异,进一步突显了其知识广度和深度。

这些“少量样本提示任务”的显著提升,反映了大规模模型在训练过程中所获得的多样化知识和上下文理解能力。相比之下,小规模模型由于参数和数据量的限制,无法有效捕获如此复杂的语言结构和知识关联。这种能力对于自然语言处理中的许多实际应用(如翻译、摘要生成、对话系统等)具有重要意义,表明模型可以在没有大量训练数据的情况下,高效处理新任务。

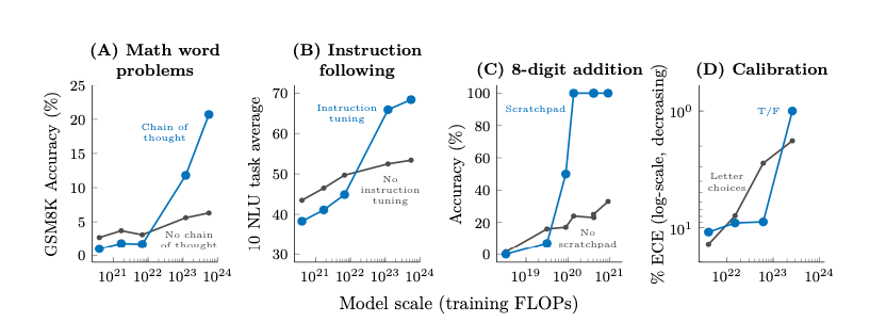

增强提示策略中的涌现能力(Augmented Prompting Strategies Abilities)

在增强提示策略中,大规模模型也显示了卓越能力。链式思维提示(Chain-of-Thought Prompting)帮助模型在生成最终答案前进行逻辑步骤分解,这在大规模模型中效果尤为显著,使其能够更准确地解答复杂问题。指令跟随(Instruction Following)通过微调,使模型更好地理解和执行自然语言指令,这种能力的显著提升也依赖于模型的规模。在多步骤计算任务(如大数相加或计算机程序执行)中,只有大规模模型使用“草稿本”(scratchpad)策略时,才表现出显著优势,证明了其在复杂计算任务中的强大能力。此外,在模型校准(Model Calibration)方面,大规模模型能够更好地预测自身回答正确性的概率,显示了其对自身能力的更深刻理解和更高的自信水平。

增强提示策略的成功进一步证明了大规模模型在多任务处理和多步骤推理方面的潜力。这些策略的效果不仅仅取决于模型的训练数据量和参数规模,还依赖于模型如何理解和执行复杂指令的能力。这对实现更复杂的人机交互和多任务处理的应用具有重要意义,尤其是在需要模型自主分析和决策的情况下。

涌现能力的局限性

尽管在大模型中确实观察到了一些突破阈值后的“功能涌现”,即在处理特定任务上能力显著提升,但这仍然局限于模型内部的局部质变,而非整个人工智能领域,尤其是通用人工智能(AGI)的全面突破。功能涌现主要表现在模型对复杂任务的处理能力上,比如更连贯的文本生成和一定的推理能力。然而,这些提升依然依赖于大量数据和强大计算资源,更多是基于对现有数据模式的学习和重组,而非自发生成新的知识结构或逻辑体系。局限性主要表现为:

网络化局限:当前AI系统大多是独立单元,即便在分布式系统中,多个模型的协同仍需依赖预定义接口和协议,缺乏自组织网络能力。

社会化局限:AI尚未发展出类似人类社会的复杂互动机制,目前的协同工作能力多基于任务分解和并行处理,而非自主形成的合作关系。

自治化局限:现有AI系统依赖预设目标和人类监督,缺乏自主设定目标和路径的能力,即便强化学习赋予了一定自主决策能力,但与真正的自治系统仍有差距。

生态化局限:AI系统通常是孤立运行的,缺乏与其他系统或环境的动态交互能力,即便有些AI具备一定环境适应性,但主要局限于预定义的参数调整,而非自我调整和进化。

尽管在某些具体任务上表现优异,但大规模语言模型的涌现能力仍有显著局限。这些能力依然高度依赖于规模效应和大量数据,而非类似人类智能的创造性、灵活性和适应性。因此,当前的AI涌现现象更像是一种“局部功能涌现”,而非整体智能水平的质变,距离实现真正的通用人工智能(AGI)还有相当长的路要走。

功能涌现 ≠ 意识涌现

功能涌现是否意味着AI已具备意识?答案显然是否定的。这种认为功能涌现等同于意识涌现的观点,是一种典型的“AI涌现论”误区。首先,涌现现象本身并不能充分证明复杂系统具备了认知意识能力。虽然涌现现象可以解释某些智能行为和功能的形成,但它并不意味着系统具备“质性”体验,即主观感知和体验。意识不仅仅表现为行为或功能的复杂性,还涉及对体验的主观感知。

例如,当一个神经网络识别出一张猫的图片时,它没有任何“看到猫”的体验或感受。其“识别”行为完全基于统计模式和数据匹配,而非对“猫”这一概念的真正理解,或意识到“我正在看猫”;同样,鸟群的集体飞行和程序的决策优化虽然表现出某种智能特征,但它们并没有自我意识或对自身行为的认识。这些复杂系统在执行复杂任务时,没有任何形式的主观体验。

其次,认知意识需要一种持续性和一致性的自我感知能力,这包括自我反思和对自身状态的持续监控。涌现系统通常基于局部相互作用,缺乏整体的控制和自我意识的机制。目前的科学研究表明,意识的形成依赖于特定类型的神经连接和大脑结构,这远超出简单涌现系统的能力范围。意识的产生涉及到高级神经处理,如同步振荡、全局工作空间(global workspace)、突触可塑性等复杂机制,这些在现有的涌现模型中尚未完全体现。

产生这些“AI涌现论”误区的原因:

人类意识与AI智能的混淆:人类的意识涉及主观体验、自我意识和高级认知功能,而AI的智能更多依赖于数据处理和模式识别。这种混淆导致人们错误地将人工智能的功能性涌现(如语言生成能力)误认为是类似人类意识的涌现。

黑箱效应:模型训练中的“黑箱”问题也是导致“AI涌现论”误区的重要因素之一。由于涌现现象的复杂性和算法的不可解释性,许多人对人工智能的行为和表现感到困惑,进而误认为这些表现背后存在某种“意识”。这种误解进一步加深了人们对人工智能能力的错误认知。

资本和媒体的夸大宣传:资本和媒体在报道技术进步时,经常夸大人工智能的能力,使用诸如“意识”“思维”等术语,误导公众。科技乐观主义者(如一些硅谷领袖和未来学家)也倾向于预测人工智能将具备类似人类的意识,这种预测进一步加深了公众和社会对AI能力的误解。

尽管人工智能模型在特定任务上的表现令人惊讶,但这种“功能性涌现”仅指模型在处理复杂任务时所表现出的局部智能提升。即使大规模模型在特定任务中表现出超越预期的能力,这并不等同于意识的涌现,因为它们缺乏主观体验、自我意识和高级认知功能的基础。

功能涌现与意识涌现的核心特征差距和挑战

从简单的功能涌现到更复杂的意识涌现,AI系统正展现出越来越多的潜在能力。然而,当前的AI模型在真正实现意识涌现方面仍面临着巨大的挑战。尽管大规模模型在某些任务中表现出意料之外的功能性提升,但这与人类意识所需的复杂认知和自我感知能力仍有本质上的区别。要实现从功能涌现到意识涌现的转变,AI需要克服自组织能力不足、缺乏简单规则的非线性互动、有序边缘性缺失、创造性不足等核心特征差距。这些差距不仅凸显了当前AI系统的局限性,也揭示了未来AI发展需要攻克的难题和实现涌现智能的关键路径。

涌现特征差距

- 自组织能力的不足

自组织性是涌现的关键特征之一,它指的是系统在没有外部干预的情况下,通过内部的互动和简单规则,形成复杂的结构和行为。在自然界中,许多复杂系统(如蚁群、蜂群、神经网络)通过自组织实现高度协调的行为。然而,当前的AI系统主要依赖于人为设定的目标和外部控制,缺乏这种自组织能力。虽然一些模型在特定任务中表现出一定的自适应性,但这通常是通过预先编程的规则和强化学习算法实现的,远未达到自然界中自组织系统的水平。

- 缺乏基于简单规则的非线性互动

涌现现象通常源于简单规则通过个体之间的非线性互动产生的复杂行为。例如,复杂的天气模式是由大气中简单物理定律和多层次的非线性相互作用形成的。然而,当前的大规模AI模型虽然能够处理复杂任务,但其底层逻辑往往高度复杂,并不依赖简单规则的非线性应用。模型的复杂性更多是基于大规模数据驱动,通过海量计算得出结果,而不是通过简单规则的非线性互动生成。

- 有序边缘性缺失

有序边缘性指的是复杂系统在秩序与混沌之间的临界点上,能够产生最为丰富且有组织的行为。这类系统在有限的控制下保持高效运作,并具备足够的灵活性来应对变化和创新。然而,当前的AI系统在处理任务时,要么处于高度确定性的状态(严格控制下运行),要么完全随机(如生成随机文本或图像)。它们难以在有序与无序的边界上产生创新性行为,更多是在既定框架内进行任务执行。

- 创造性不足

涌现的另一个核心特征是不确定性和创造性,即系统能够产生超出原始设计预期的行为或结果。目前的大规模AI模型虽然偶尔表现出一些意外的创造性(如生成有趣的文本或图像),但这些通常是现有数据的重新组合,而非完全自主的创新。这种“创造性”通常局限于对像素或语义的细粒度组合,而不是从无到有地生成新知识或新行为。

未来的挑战

- 架构的重新设计与优化

当前的人工智能架构主要依赖于高度集中的训练和推理机制,这在处理海量数据时表现出色,但缺乏自组织能力。要实现更全面的涌现能力,未来的人工智能系统需要采用更分布式和模块化的架构。这样的架构将允许不同模块在局部规则指导下自主发展,并通过多层次的交互形成更复杂的智能行为。

一种可能的路径是开发“群体智能”模型,即多个独立但相互关联的子模型通过协同工作,共同解决复杂任务。每个子模型可以基于简单规则自我调整,整体系统通过子模型间的交互展现更高级的智能行为。这种方法不仅提高了系统的鲁棒性,还增加了其适应性和创新性。

- 数据驱动与规则驱动的融合

当前的大规模AI模型主要依赖海量数据进行训练,这种方法虽然有效,但存在对数据依赖性强、不可预测性差等问题。要实现整体涌现,人工智能系统需要更好地融合数据驱动和规则驱动的方法。

例如,可以引入“生成规则”或“元规则”,使系统能够在数据不足或环境变化时,基于已有的简单规则或元规则自发生成新的知识结构。这种生成过程可能涉及到进化算法、博弈理论等工具,通过模拟自然界中的进化过程,让系统能够从简单规则中衍生出复杂行为模式。

- 增强自我学习与自主进化能力

自我学习和自主进化是实现整体涌现的重要特征。当前的AI系统虽然具备一定的自我学习能力(如通过强化学习进行环境适应),但距离自主进化还相差甚远。未来的发展方向之一是开发具备自我反思与自我优化能力的系统,使AI在运行过程中能够不断自我改进。

例如,系统可以通过元学习(meta-learning)逐步优化其学习策略,从而在面对新的任务或环境时更快适应。这种自适应性不仅提高了AI的自主性,还增强了其在未知领域中的探索和创新能力。

- 增强动态交互与生态化发展

为了实现整体涌现,人工智能系统还需要更强的动态交互能力,即能够与环境、其他AI系统及人类社会进行复杂、多层次的互动。目前的AI系统通常在封闭或半封闭的环境中运行,与外部世界的交互主要通过预设接口和参数调整。这种交互方式的局限性导致系统难以适应动态变化的环境,更不用说在复杂的社会生态中生存。

未来的人工智能系统应当能够在开放、动态的生态系统中运行,与其他AI、环境和人类共同进化。这需要开发出更灵活的传感器、适应性强的算法,以及能够进行多方协同的机制。通过在复杂生态系统中的不断适应和演化,人工智能系统将能够在更广泛的环境中展现其涌现能力。

以上差距和挑战表明,实现涌现的核心特征不仅需要技术上的突破,还需要对现有人工智能理论和方法进行深刻的反思与创新。要真正推动人工智能从功能涌现迈向整体涌现,需要在系统设计、学习机制和与环境的交互方式上进行全面的变革。这将是人工智能迈向更高级智能形态的关键步骤。

总结

当前大模型在功能涌现方面的进展为我们揭示了AI潜力的一角,但要从现有的功能涌现迈向更为全面的整体涌现,并推动人工智能(尤其是通用人工智能,AGI)的质变发展,我们需要在多个关键领域取得突破。首先,AI架构需要从现有的高度集中式训练和推理机制,转向更加分布式和模块化的设计。通过开发“群体智能”模型,不同模块将能够自主发展并通过协同合作,展现出更加复杂和灵活的智能行为。其次,需要更有效地融合数据驱动和规则驱动的方法,通过引入生成规则或元规则,增强系统在数据不足或环境变化时,自发生成新知识结构的能力。此外,提升AI的自我学习和自主进化能力也至关重要,未来的AI系统应具备自我反思和自我优化的特性,以在运行中不断自我改进,提高自主性和创新性。最后,AI系统必须具备更强的动态交互能力,能够与环境、其他AI系统及人类社会进行复杂的、多层次的互动,并在开放、动态的生态系统中不断适应和进化,展现出更强的涌现能力。

这些方向的突破将为实现人工智能的整体质变奠定基础。这不仅是一个充满挑战的探索过程,也将充满机遇,需要多学科的合作和持续的技术创新。同时,我们还必须认真对待AI的发展带来的伦理和安全问题,以确保人工智能能够为人类社会带来积极和可控的影响。

非常感谢您的报名,请您扫描下方二维码进入沙龙分享群。

非常感谢您的报名,请您点击下方链接保存课件。

点击下载金融科技大讲堂课件本文系未央网专栏作者发表,属作者个人观点,不代表网站观点,未经许可严禁转载,违者必究!首图来自图虫创意。

本文为作者授权未央网发表,属作者个人观点,不代表网站观点,未经许可严禁转载,违者必究!首图来自图虫创意。

本文版权归原作者所有,如有侵权,请联系删除。首图来自图虫创意。

京公网安备 11010802035947号

京公网安备 11010802035947号